Ein Jahrhundert der Entwicklung in der Hardware und Bildoptik von Überwachungskameras

Die mechanische Vorgeschichte: Von der kinetischen Aufzeichnung bis zu Closed-Circuit-Prototypen

Die technische Entwicklung von Sicherheitskameras war kein Erfolg über Nacht, sondern eine interdisziplinäre Entwicklung, die sich über zwei Jahrhunderte erstreckte. Seine Wurzeln lassen sich bis ins späte 19. Jahrhundert zurückverfolgen, als die ersten Versuche unternommen wurden, kontinuierlich dynamische Bilder einzufangen. Im Jahr 1870 patentierte der englische Erfinder Wordsworth Donisthorpe den „Kinesigraphen“, eine Bewegtbildkamera, die dazu entwickelt wurde, in festgelegten Abständen eine Reihe von Fotos aufzunehmen, um Bewegungen einzufangen.1Im Jahr 1889 verfeinerten Donisthorpe und Louis Le Prince Filmkameras und Projektionstechnik weiter; Le Prince entwickelte sogar eine 16-Linsen-Kamera, die damals zwar eher ein experimentelles Werkzeug war, aber die physikalische Grundlage für die kontinuierliche Überwachung bestimmter Räume legte.1

Das erste echte CCTV-System (Closed-Circuit Television) entstand aus militärischen Gründen während des Zweiten Weltkriegs. Im Jahr 1942 wurde der deutsche Ingenieur Walter Bruch damit beauftragt, ein System zur Überwachung von A4 (V-2)-Raketenstarts aus einem sicheren Bunker zu entwerfen und zu überwachen.1Der Kern dieses Systems war sein „geschlossener Kreislauf“, was bedeutet, dass Videosignale nur an voreingestellte, nicht öffentliche Monitore übertragen wurden. Die damalige Bildgebungstechnologie basierte ausschließlich auf sperrigen Vakuumröhren und komplexen analogen Schaltkreisen ohne Aufzeichnungsmöglichkeiten. Das Sicherheitspersonal musste die Monitore in Echtzeit beobachten, da die Informationen für immer verloren gingen, sobald das Bild verschwand.2

1949 brachte das amerikanische Unternehmen Vericon das erste kommerzielle CCTV-System auf den Markt und markierte damit den Übergang vom militärischen zum kommerziellen und zivilen Sektor.3Diese frühen kommerziellen Systeme verwendeten hauptsächlich fest installierte Schwarzweißkameras, die über Koaxialkabel verbunden waren. Aufgrund der hohen Hitze, des hohen Stromverbrauchs und der 110-V-Wechselstrom-Anforderungen von Vakuumröhren war die Installation streng eingeschränkt und erforderte häufig, dass die Kamera weniger als 1,8 m von einer Steckdose entfernt sein musste.5Darüber hinaus war die optische Leistung mit Auflösungen um nur 240 Zeilen äußerst begrenzt.

Der Höhepunkt und die Gefahren von Vakuumröhren: Vidicons vs. Plumbicons

Bevor die Halbleiter-Bildgebungstechnologie ausgereift war, waren Vakuumröhren (Pick-up-Röhren) der einzige Kern von Überwachungskameras. Bei diesen Geräten handelte es sich im Wesentlichen um rückwärts laufende Kathodenstrahlröhren (CRT). In den 1950er Jahren entwickelten Weimer, Forgue und Goodrich von RCA das Vidicon, eine Speicherkameraröhre, die einen lichtempfindlichen Halbleiter (ursprünglich Antimontrisulfid) als Target nutzte.7

Physikalischer Mechanismus und Materialbeschränkungen

Das Funktionsprinzip einer Kameraröhre besteht darin, eine Szene über eine optische Linse auf ein lichtempfindliches Ziel zu fokussieren, das dann von einem Elektronenstrahl niedriger Geschwindigkeit aus einer Elektronenkanone abgetastet wird. Wenn Licht auf das Ziel trifft, ändert sich die lokale Leitfähigkeit, wodurch der Elektronenstrahlstrom schwankt und Licht in Videosignale umgewandelt wird.8Das Vidicon reduzierte Kameragröße und -kosten erheblich und machte es zum Standard für die Überwachung außerhalb von Rundfunkübertragungen.7

Allerdings litt das Vidicon unter einem fatalen „Burn-out“-Defekt. Wenn das lichtempfindliche Ziel zu lange auf die Sonne, stark reflektierende Oberflächen oder helle Lichtpunkte gerichtet würde, würde es bleibende physische Schäden erleiden und „tote Winkel“ entstehen.8Darüber hinaus waren Vidicons anfällig für den „Mikrofoneffekt“, bei dem laute Geräusche oder Explosionen physische Vibrationen im Dünnschichtziel verursachten und horizontale Balken auf dem Bildschirm erzeugten.8

Um die geringe Empfindlichkeit und das starke „Nachlaufen“ (Kometenschweife) des Vidicon zu überwinden, führte Philips in den 1960er Jahren den Plumbicon ein. Durch die Verwendung von Bleioxid als Ziel bot der Plumbicon ein hohes Signal-Rausch-Verhältnis und eine extrem geringe Bildverzögerung.7Während es im Rundfunk erfolgreich war, beschränkten seine hohen Kosten seinen Einsatz im Sicherheitsbereich auf High-End-Anwendungen. Erst in den späten 1970er Jahren erfüllten Vakuumröhren mit der Entwicklung von Low-Light-Technologien wie Tivicon (Siliziumdiodenröhre) und Newvicon (hergestellt von Panasonic) die Grundbedürfnisse der Nachtüberwachung.10

Die folgende Tabelle fasst die Entwicklung früher Vakuumröhren-Überwachungskameras zusammen:

| Technische Phase | Kernsensor | Repräsentatives Jahr | TV-Leitungen | Hauptmerkmale | Einschränkungen |

| Einleitung | Frühe Fotoröhren | 1942 | 100-200 | Militärischer Einsatz, Echtzeitbeobachtung |

Extrem sperrig, keine Aufnahme4 |

| Vermarktung | Vidicon | 1950er Jahre | 240 | Einfache Struktur, Kostenreduzierung |

Leicht auszubrennen, geringe Empfindlichkeit7 |

| Leistungssteigerung | Plumbicon | 1960er Jahre | 400+ | Hohes SNR, geringe Verzögerung |

Sehr teuer8 |

| Analoger Peak | Newvicon/Saticon | 1970er Jahre | 480-700 | Frühzeitige Low-Light-Fähigkeit |

Immer noch groß, abhängig von der Wechselstromversorgung10 |

Der Nobelmoment des Siliziums: Die Geburt und Herrschaft von CCD

1969 war ein Meilenstein in der Geschichte der modernen Bildgebung. Willard Boyle und George Smith von den Bell Labs erfanden das ladungsgekoppelte Bauelement (CCD), eine Leistung, die ihnen später den Nobelpreis für Physik einbrachte.13Das CCD revolutionierte die Hardware von Überwachungskameras, indem es empfindliche Vakuumröhren durch Halbleiter-Siliziumchips ersetzte.13

Die Kunst der Ladungskopplung: Die Wassereimer-Analogie

Das Funktionsprinzip eines CCD kann mit einer „Anordnung von Eimern, die Regenwasser sammeln“ verglichen werden. Jedes Pixel (Siliziumatom) auf dem Sensor fungiert wie ein Eimer, der Photonen (Regentropfen) sammelt. Der photoelektrische Effekt wandelt Photonen in Photoelektronen um, die in Potentialtöpfen gespeichert werden. Während der Auslesephase werden diese Ladungen Reihe für Reihe wie bei einem Staffellauf zu einem Ausleseverstärker bewegt und in Spannung umgewandelt.13Der Vorteil von CCD liegt in der hohen Bildgleichmäßigkeit und dem geringen Musterrauschen, da sich alle Pixel in der Regel einen bis vier Ausleseverstärker teilen, was die Konsistenz gewährleistet.13

Fairchild Semiconductor brachte 1973 den weltweit ersten kommerziellen CCD, den MV-100, mit einer Auflösung von nur 100 x 100 Pixeln auf den Markt.14Obwohl sie ursprünglich für den industriellen und militärischen Einsatz gedacht war, ebnete sie den Weg für Überwachungskameras im „Taschenformat“.16Sony investierte in den 1970er Jahren unglaubliche 20 Milliarden Yen in Forschung und Entwicklung und brachte schließlich 1980 die Farb-CCD-Kamera XC-1 auf den Markt.18Dieser Schritt, der damals als selbstmörderisches Wagnis galt, machte Sony jahrzehntelang zur dominierenden Kraft auf dem globalen Markt für Bildsensoren.19

Das goldene Zeitalter der analogen Überwachung und PCB-Evolution

Während der Herrschaft des CCD in den 1980er und 1990er Jahren erfuhr auch die interne Kameraelektronik radikale Veränderungen. Die Leiterplattentechnologie (PCB) wurde von Phenolpapier auf Glasfasersubstrate verlagert, was die thermische Stabilität und Signalintegrität erheblich verbesserte.6In den 1970er Jahren unterstützten Leiterplatten nur eine einseitige Verdrahtung; In den 1980er Jahren ermöglichten doppelseitige Leiterplatten die Integration weiterer Signalverarbeitungskomponenten (wie frühe Videoprozessoren) in kleine Kameragehäuse.6In dieser Zeit nutzten Sicherheitssysteme Koaxialkabel zur Übertragung analoger Signale, wobei die Auflösung die physikalische Grenze der Analogtechnik erreichte – etwa 700 TV-Zeilen (TVL).5

CMOS APS und die digitale Revolution: Von „Capture“ zu „Compute“

Während CCD lange Zeit führend in der Bildqualität war, schränkten seine komplexe Herstellung, sein hoher Stromverbrauch und die Unfähigkeit, Logikschaltungen zu integrieren, die Weiterentwicklung der Kameraintelligenz ein. Mitte der 1990er Jahre begann die Technologie des Complementary Metal-Oxide-Semiconductor Active Pixel Sensor (CMOS APS) zu reifen.13

Der Architekturkampf: CMOS vs. CCD

Im Gegensatz zur „seriellen Auslesung“ von CCD verfügt jedes Pixel in einem CMOS-Sensor über einen eigenen Verstärker und eine eigene Ausleseschaltung. Diese Architektur bietet mehrere technische Vorteile:

-

Hohe Integration:Bildsignalprozessoren (ISP), Analog-Digital-Wandler (ADC) und Zeitsteuerschaltungen können auf demselben Siliziumchip integriert werden und so ein System-on-Chip (SoC) bilden.21

-

Ultrahohe Geschwindigkeit:Mit Tausenden von Auslesekanälen können die CMOS-Geschwindigkeiten 100-mal schneller sein als die von CCD, was eine Überwachung mit hoher Bildrate (60 fps oder höher) und Zeitlupenwiedergabe ermöglicht.13

-

Leistungssteuerung:CMOS verbraucht nur beim Pixelwechsel erhebliche Energie, wodurch die Wärmeentwicklung drastisch reduziert wird – ein entscheidender Faktor für den 24/7-Sicherheitsbetrieb.13

Im Jahr 2007 erreichte CMOS die Marktparität mit CCD, und im Jahr 2019, mit der Popularität der Back-Illuminated-Technologie (BSI), übertraf die Leistung von CMOS die von CCD.13BSI ordnet die Sensorschichten neu an, sodass das Licht vor der Schaltkreisschicht auf die Fotodiode trifft, was die Quanteneffizienz (QE) drastisch erhöht und den Grundstein für die „Starlight“-Überwachung legt.14

Die folgende Tabelle vergleicht CCD und CMOS in modernen Sicherheitsanwendungen:

| Parameter | CCD-Sensor | CMOS-Sensor (APS) | Auswirkungen auf Trends |

| Auslesegeschwindigkeit | 1 - 40 MPS | 100 - 400+ MPS |

HD-Videostreaming aktiviert13 |

| Lesen Sie Lärm | 5 - 10 Elektronen | 1 - 3 Elektronen |

Verbesserte Klarheit bei schlechten Lichtverhältnissen13 |

| Dynamikbereich | Hoch (Vollformat) | Extrem hoch (HDR) |

Ermöglichte WDR-Durchbrüche15 |

| Kosten | Hoch (Speziallinien) | Niedrig (Standard-CMOS) |

Demokratisierung der Kamera vorangetrieben13 |

| Integration | Niedrig (Externe Chips) | Hoch (Einzelchip-SoC) |

Führte zu Edge AI-Kameras22 |

Evolution optischer Linsen: Vom festen Glas zu intelligenten Systemen

Wenn der Sensor die „Retina“ einer Kamera ist, ist das Objektiv ihre „Kristalllinse“. Aus Sicherheitsgründen müssen Objektive ihr Auflösungsvermögen auch in sehr unterschiedlichen Umgebungen beibehalten.

Aberration überwinden: Der Aufstieg asphärischer Elemente

Frühe Überwachungslinsen waren meist sphärisch. Die physikalische Beschaffenheit sphärischer Linsen bedeutet, dass Lichtstrahlen an den Rändern und in der Mitte nicht am gleichen Punkt konvergieren, was zu sphärischer Aberration und Kantenunschärfe führt.26Um dieses Problem zu lösen, begannen Sicherheitslinsen mit der Masseneinführung asphärischer Elemente. Obwohl die Theorie 1637 von Descartes aufgestellt wurde, ermöglichte die Präzisionsformung von Glas erst in den 1980er Jahren die Massenproduktion und ermöglichte größere Blendenöffnungen (F/1,4 oder F/1,0) ohne Einbußen bei der Klarheit.27

Zoom und automatische Back-Focus-Korrektur

In den 1970er Jahren führte der Bedarf an flexiblen Betrachtungswinkeln zur Geburt von Zoomobjektiven. Allerdings verlieren herkömmliche Zoomobjektive bei Brennweitenänderungen oft den Fokus. Um Klarheit zu gewährleisten, hat die Industrie „Back-Focus Adjustment“-Mechanismen entwickelt, um den Fokus vom Weitwinkel- bis zum Teleobjektiv auf der Sensorebene zu fixieren.29Moderne motorisierte Zoomobjektive verfügen über Präzisionsschrittmotoren, um das Sichtfeld basierend auf Alarmauslösern automatisch anzupassen.26

P-Iris: Lösung des Beugungsdilemmas im HD-Zeitalter

Als die Sensorauflösung von 0,3 MP auf 8 MP (4K) stieg, traten die Mängel herkömmlicher Objektive mit automatischer Blende zutage. Herkömmliche DC-Irisblenden passen die Öffnungsgröße nur basierend auf der Helligkeit an. In hellen Umgebungen schließt sich die Iris so stark, dass es zu starker Beugung kommt und das Bild unscharf wird – ein Phänomen, das als „optische Grenze“ bekannt ist.30

Um dem entgegenzuwirken, führte Axis Communications die P-Iris-Technologie (Precise Iris) ein. P-iris verlässt sich nicht ausschließlich auf Lichtsensoren; Es nutzt Software zur Kommunikation mit einem Schrittmotor im Objektiv.

-

Optimale Blendenauswahl:Die Software identifiziert den „Sweet Spot“ des Objektivs (normalerweise eine Blende im mittleren Bereich) und behält ihn so weit wie möglich bei.30

-

Verstärkungs- und Belichtungsverknüpfung:Wenn das Licht zu stark ist, priorisiert das System eine kürzere Belichtung oder eine elektronische Verstärkungsreduzierung, anstatt die Blende übermäßig zu schließen und so Beugung zu vermeiden.30

-

Maximierte Schärfentiefe:Bei Szenen wie langen Korridoren optimiert die P-Iris die Schärfentiefe, um sicherzustellen, dass Vorder- und Hintergrund klar bleiben.33

ISP-Fortschritt: Der Aufstieg des digitalen Sehnervs

Rohdaten vom Sensor müssen von einem Bildsignalprozessor (ISP) verarbeitet werden, um sichtbar zu sein. Die Entwicklung des ISP hat die Sicherheitsüberwachung vom „Sehen“ zum „Klaren und genauen Sehen“ verändert.

Technische Wege zum Wide Dynamic Range (WDR)

In Szenen mit Hintergrundbeleuchtung (z. B. einem Bankfenster) kann der Unterschied zwischen hellen und dunklen Bereichen das 100.000-fache überschreiten. ISPs handhaben dies mit drei Hauptmethoden:

-

Digitaler WDR (DWDR):Ein Softwarealgorithmus, der Gammakurven anpasst, um dunkle Bereiche aufzuhellen. Niedrige Kosten, aber hoher Lärm.35

-

Echtes WDR (Multi-Exposure Fusion):Die Mainstream-High-End-Lösung. Der ISP weist den Sensor an, zwei Bilder schnell hintereinander aufzunehmen: eine kurze Belichtung (Lichter) und eine lange Belichtung (Schatten). Die Registrierung auf Pixelebene führt sie dann nahtlos zusammen.36

-

Forensischer WDR:Eine optimierte Version zur Reduzierung von Bewegungsartefakten, um sicherzustellen, dass bewegte Objekte keine „Geisterbilder“ aufweisen, was für die Nummernschilderkennung von entscheidender Bedeutung ist.25

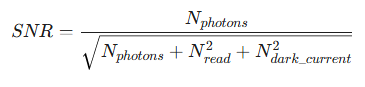

Das Signal-Rausch-Verhältnis (SNR) in ISP-Algorithmen kann beschrieben werden durch:

Extreme Durchbrüche bei schlechten Lichtverhältnissen: Sternenlicht und Schwarzlicht

Die letzte Grenze der Sicherheit ist die Dunkelheit. Herkömmliche IR-Nachtsicht führt zu einem Farbverlust, wodurch es unmöglich wird, Kleidungs- oder Fahrzeugfarben zu erkennen.40

Die drei Hardware-Säulen der „Starlight“-Kameras

Der Starlight-Erfolg beruht auf der Überwindung körperlicher Grenzen:

-

Großformatige Sensoren:Verwendung von 1/1,8-Zoll- oder sogar 1/1,2-Zoll-Sensoren. Dadurch vergrößert sich die lichtempfangende Fläche pro Pixel, wodurch mehr Photonen eingefangen werden.39

-

Optik mit ultragroßer Apertur:Ausgestattet mit F/1,0- oder F/0,95-Objektiven, die eine viermal höhere Lichtaufnahme als Standard-F/2,0-Objektive bieten.26

-

Slow-Shutter-Algorithmen:Stapeln von Frames im ISP, um die Integrationszeit zu erhöhen. Dies führt zwar zu einer gewissen Bewegungsunschärfe, erzeugt jedoch in Umgebungen mit 0,001 Lux tagesähnliche Farbbilder.24

Schwarzlicht (DarkFighter X) Dual-Sensor-Fusion

Wenn das Licht unter 0,0001 Lux sinkt, reicht die Verstärkung allein nicht aus. Hersteller wie Hikvision (DarkFighter X) und Keda haben die Blacklight-Technologie eingeführt, die die Stäbchen und Zapfen des menschlichen Auges nachahmt:

-

Optische Aufteilung:Ein spezielles Prisma teilt das Licht in Infrarot- und sichtbare Strahlen auf.44

-

Duale Sensoren:Ein Sensor erfasst IR (Luminanz und Details), während der andere schwaches sichtbares Licht (Farbe) erfasst.

-

Fusion auf Pixelebene:Der ISP passt die beiden Pfade in Echtzeit an und gibt helle, vollfarbige und rauscharme Videos aus. Dies erfordert eine Genauigkeit der Subpixel-Kalibrierung.44

Mehrlinsen-Synergie und computergestützte Bildgebung: Eine neue Ära

Moderne Überwachung geht über eine einzelne Perspektive hinaus und hin zu Multisensor-Fusionsplattformen.

Panorama-Spleißen (PanoVu) und Dual-Lens-Verbindung (TandemVu)

Um weitläufige Bereiche wie Plätze oder Flughäfen abzudecken, integriert die PanoVu-Serie von Hikvision 4 bis 8 Sensoren. ISP-Algorithmen führen ein „nahtloses Stitching“ durch, das Folgendes umfasst:

-

Belichtungskonsistenz:Sicherstellen, dass die Helligkeit aller Sensoren gleichmäßig ist.45

-

Pixelregistrierung:Eliminiert tote Winkel und Geisterbilder an den Nähten.45

-

Multidirektionale Überwachung:Eine IP-Adresse und ein Kabel können eine 360-Grad-Ansicht verwalten und so die Systemkosten senken.47

Computergestützte Fotografie und intelligente Beleuchtung

Computational Imaging verwischt die Grenze zwischen Hardware und Software.

-

Intelligentes Hybridlicht:Kameras wie das Smart Hybrid Light von Hikvision nutzen KI, um vom diskreten IR-Modus in den Weißlicht-Farbmodus zu wechseln, wenn eine Person oder ein Fahrzeug erkannt wird.41

-

Multispektrale Fusion:Verschmelzung von thermischem (LWIR) und sichtbarem Licht. Thermisch erkennt Hitze (verborgene Ziele), während sie sichtbar identifiziert wird, wodurch die Genauigkeit des Perimeterschutzes erheblich verbessert wird.51

Vision 2030: Die disruptive Zukunft der Sicherheitshardware

Mit Blick auf das Jahr 2030 wird sich die Form von Überwachungskameras erneut qualitativ verändern.

Linsenlose Bildgebung und Quantensensoren

Untersuchungen deuten darauf hin, dass „linsenlose Kameras“, die auf computergestützter Optik basieren, immer ausgereifter werden. Durch die Verwendung dünner optischer Encoder anstelle von Glaslinsen können Kameras so dünn wie Aufkleber werden.20Darüber hinaus ermöglichen Single-Photon Avalanche Diodes (SPAD) die Bildgebung unter Nulllichtbedingungen (Photonenzählung).20

Emotions- und Absichtserkennung

Bis 2030 werden Kameras nicht nur visuelle Werkzeuge sein:

-

Biometrische Überwachung:Verwendung von Laser-Doppler-Vibrometern mit großer Reichweite zur Erfassung von Herzschlägen und Atmung.55

-

Emotionsanalyse:Tiefe neuronale Netze analysieren Mikroausdrücke und Körpersprache, um eine „Absichtsvorhersage“ durchzuführen, bevor ein Verbrechen geschieht.55

-

Kantenautonomie:Mit 5G/6G und energiesparenden KI-Chips fungieren Kameras als „digitale Wächter“, führen alle Analysen lokal durch und laden verschlüsselte Daten über Quantenprotokolle hoch.3

Fazit: Ein Jahrhundert, zusammengefasst in Licht und Schatten

Die Entwicklung von Sicherheitskameras ist eine Geschichte des endlosen Strebens der Menschheit nach „Sichtbarkeit“. Von einer Bunkermaschine aus dem Jahr 1942 bis zum heutigen KI-gestützten Terminal mit Fusion auf Pixelebene und Farbnachtsicht war jeder Schritt ein Triumph über physische Grenzen. Die Linsen wurden von sphärisch auf asphärisch umgestellt und die Blenden wurden von manuell auf P-Blende umgestellt. Sensoren wurden von sperrigen Röhren auf BSI-CMOS und hin zur Quantensensorik umgestellt; Die PCB-Technologie hat sich von einfachen Verbindungen zu leistungsstarken SoC-Plattformen entwickelt.

Die Zukunft der Sicherheit wird keine Ansammlung kalter Hardware sein, sondern eine Verschmelzung von Physik, Halbleitern und KI. Während wir die Gesellschaft schützen, wird die wahre Herausforderung für das nächste Jahrzehnt darin bestehen, das Gleichgewicht zwischen technologischem Fortschritt und Datenschutzethik zu finden.